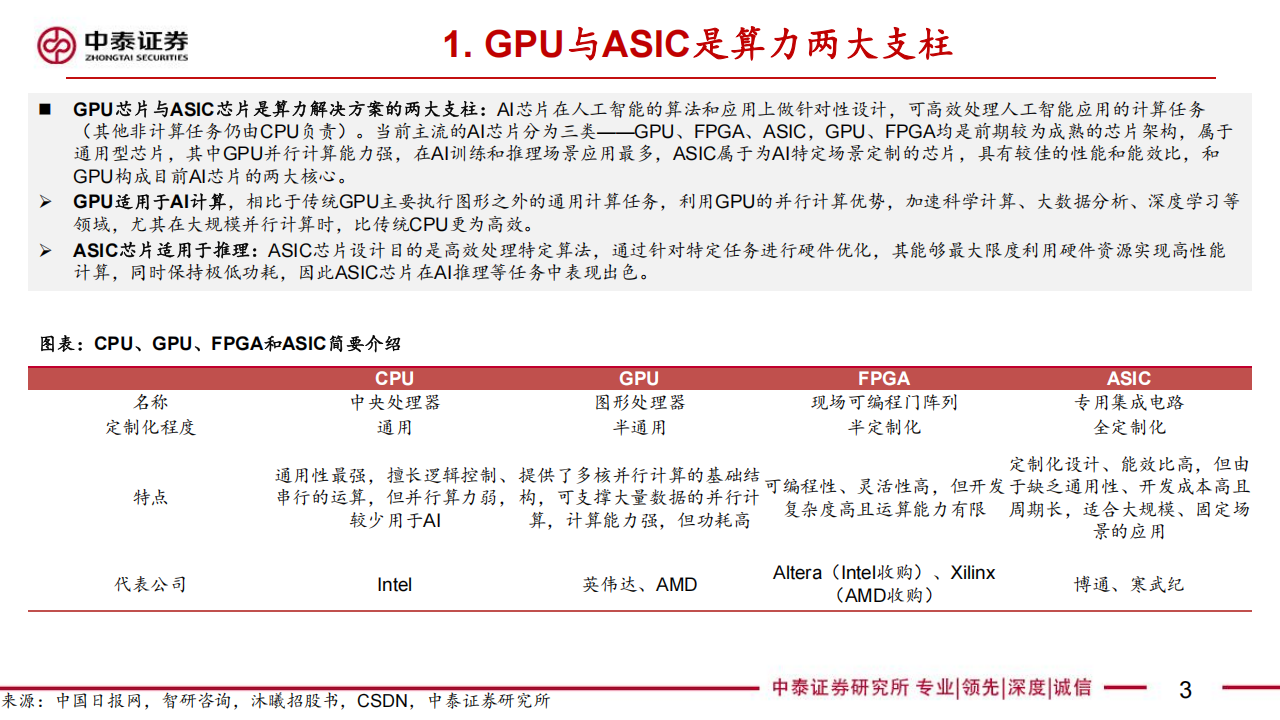

GPA芯片与ASIC芯片是算力解决方案的两大支柱:AI芯片在人工智能的算法和应用上做针对性设计,可高效处理人工智能应用的计算任务(其他非计算任务仍由CPU负责)。当前主流的AI芯片分为三类——GPU、FPGA、ASIC,GPU、FPGA均是前期较为成熟的芯片架构,属于通用型芯片,其中GPU并行计算能力强,在AI训练和推理场景应用最多,ASIC属于为AI特定场景定制的芯片,具有较佳的性能和能效比,和GPA构成目前AI芯片的两大核心。

GPU用于AI计算,相比于传统GPU主要执行图形之外的通用计算任务,利用GPU的并行计算优势,加速科学计算、大数据分析、深度学习等领域,尤其在大规模并行计算时,比传统CPU更为高效。

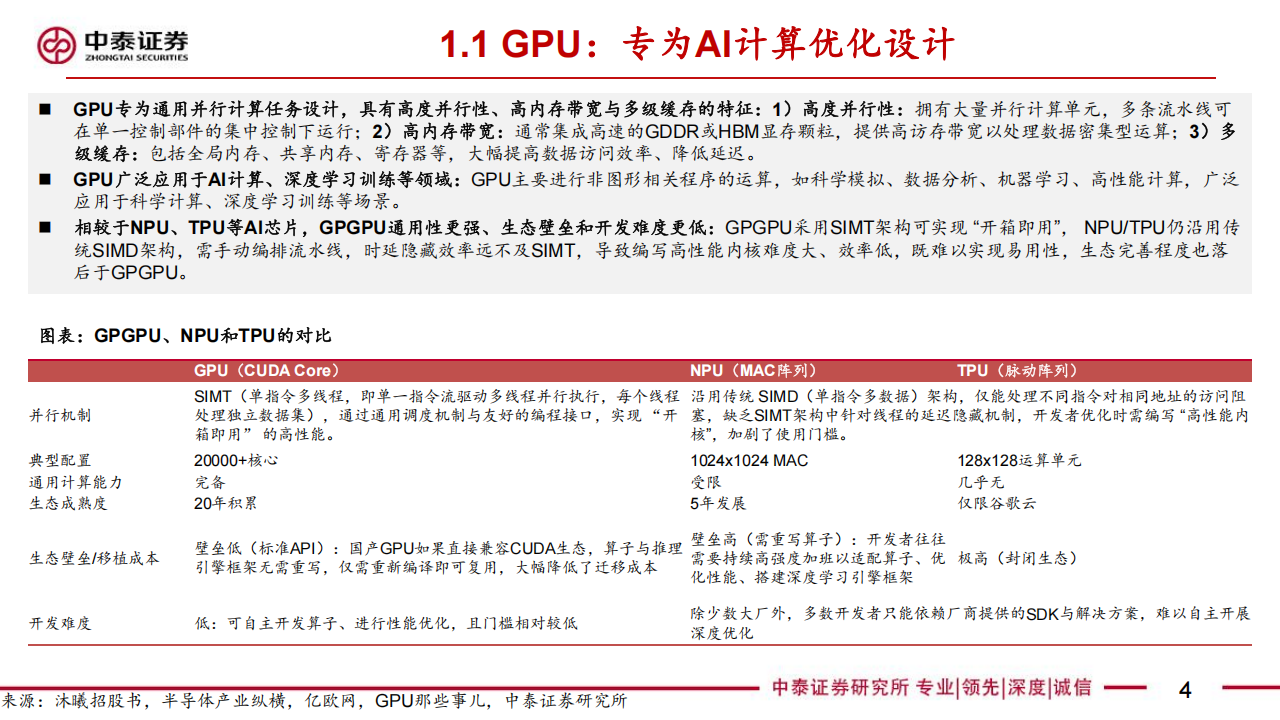

ASIC芯片适用于推理:ASIC芯片设计日的高效处理特定算法,通过针对特定任务进行硬件优化,其能够最大限度利用硬件资源实现高性能计算,同时保持极低功耗,因此ASIC芯片在AI原理等中表现出色。GPA专为通用并行计算任务设计,具有高度并行性、高内存带与多级缓存的特征:1)高度并行性:拥有大量并行计算单元,多条流水线可在单一控制部件的集中控制下运行;2)高内存带宽:通常集成高速的GDDR或HBM显存颗粒,提供高访存带宽以处理数据密集型运算:3)多级缓存:包括全局内存、共享内存、寄存器等,大幅提高数据访问效率、降低延迟。

GPU广泛应用于AI计算、深度学习训练等领域;GPU主要进行非图形相关程序的运算,如科学模拟、数据分析、机器学习、高性能计算,广泛应用于科学计算、深度学习训练等场景。

相对于NPU、TPU等AI芯片,GPGPU通用性更强、生态壁垒和开发难度更低;GPGPU采用SIMT架构可实现“开箱即用”,NPU/TPU仍沿用传统SIMD架构,需求动编排流水线,时延隐藏效率远不及SIMT,导致编写高性能内核难度大、效率低,既难以实现易用性,生态完善程度也落后于GPGPU。英伟达作为GPU的代表企业,其架构经历了Volta(12nm)→Ampere(7nm)→Hopper(4nm)→Blackwell(4nm)迭代,新一代Rubin(3nm)架构将于26年下半年推出,随AI持续迭代的过程也伴随形态、价值量快速提升。

本文来自知之小站

报告已上传百度网盘群,限时15元即可入群及获得1年期更新

(如无法加入或其他事宜可联系zzxz_88@163.com)